Robots.txt to jeden z podstawowych plików technicznego SEO. Informuje roboty wyszukiwarek, które sekcje strony mogą odwiedzać, a których nie powinny crawlować.

W sklepach internetowych robots.txt może pomagać kontrolować dostęp do filtrów, parametrów URL, stron technicznych i sekcji bez wartości SEO.

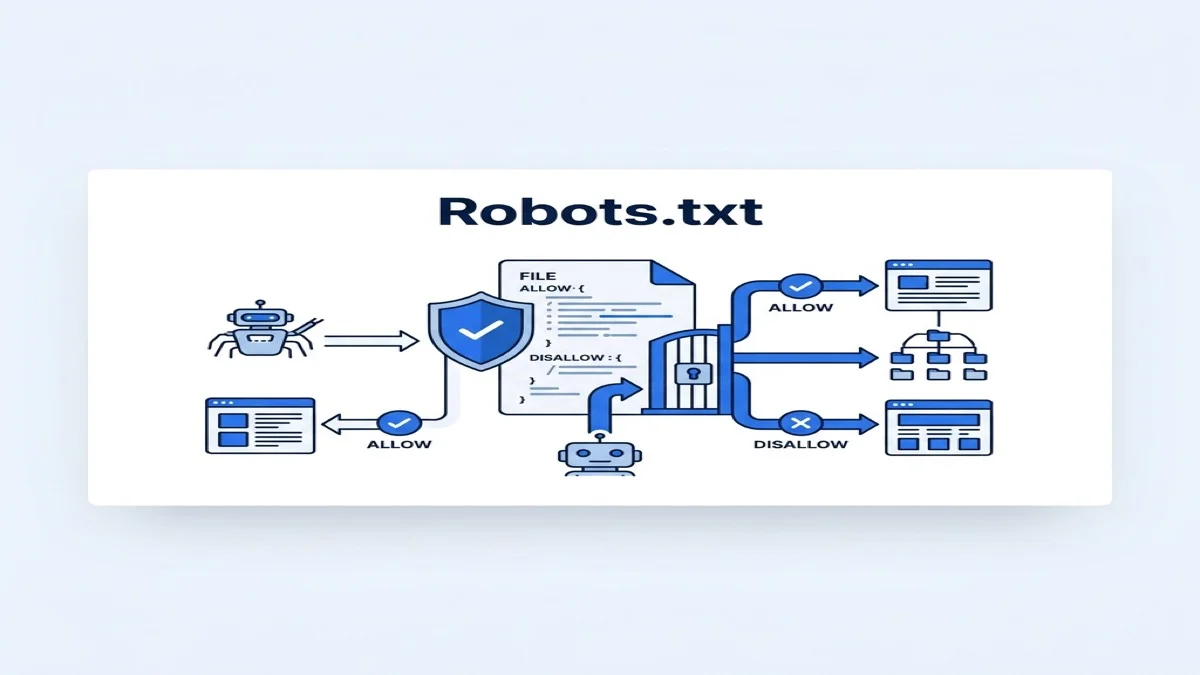

Czym jest robots.txt

Zawiera instrukcje dla robotów wyszukiwarek dotyczące tego, które obszary strony mogą być crawladowane, a które powinny zostać pominięte.

Jak działa robots.txt

Robot wyszukiwarki przed analizą strony może sprawdzić plik robots.txt. Na podstawie reguł w tym pliku otrzymuje informację, czy może wejść na dany adres URL lub sekcję strony.

Przykład pliku robots.txt

Robots.txt a SEO

Robots.txt wpływa na sposób, w jaki roboty wyszukiwarek crawlają stronę. Może pomagać ograniczać dostęp do nieistotnych technicznie sekcji, ale błędna konfiguracja może zablokować ważne strony.

Robots.txt a indeksacja

Robots.txt nie jest tym samym co noindex. Zablokowanie adresu w robots.txt nie zawsze oznacza, że strona zniknie z indeksu.

Robots.txt vs noindex

| Robots.txt | Noindex |

|---|---|

| kontroluje crawling | kontroluje indeksację |

| blokuje dostęp robota | pozwala odczytać stronę i wykluczyć ją z indeksu |

| wpływa na crawl budget | wpływa na obecność w indeksie |

| działa na poziomie dostępu | działa na poziomie indeksacji |

| może blokować analizę treści | wymaga crawlowania strony |

Robots.txt a crawl budget

Robots.txt może pomagać w zarządzaniu crawl budgetem, szczególnie w dużych sklepach internetowych. Jeżeli sklep generuje tysiące technicznych lub niskowartościowych URL, robots.txt może ograniczyć dostęp robotów do części takich sekcji.

Robots.txt w e-commerce

W sklepach internetowych robots.txt ma szczególne znaczenie, ponieważ e-commerce często generuje dużą liczbę adresów URL.

Kiedy robots.txt pomaga

Robots.txt może być przydatny, gdy trzeba ograniczyć crawling sekcji technicznych lub mało wartościowych.

Kiedy robots.txt może zaszkodzić

Błędna konfiguracja robots.txt może spowodować poważne problemy SEO.

Robots.txt a pliki CSS i JavaScript

Współczesne wyszukiwarki muszą mieć dostęp do części plików CSS i JavaScript, aby poprawnie renderować stronę. Blokowanie zasobów frontendowych może utrudniać analizę strony, layoutu i treści.

Robots.txt a sitemap.xml

Plik robots.txt często zawiera link do sitemap.xml. Sitemap pomaga wyszukiwarkom odkrywać ważne adresy URL.

Robots.txt a błędy 404

Robots.txt nie naprawia błędów 404. Jeżeli sklep posiada wiele nieistniejących adresów URL, lepszym rozwiązaniem może być analiza tych URL i przekierowanie wartościowych adresów przez redirect 301.

Robots.txt a przekierowania 301

Robots.txt nie zastępuje przekierowań 301. Jeżeli stary URL ma wartość SEO, ruch lub backlinki, zwykle lepszym rozwiązaniem jest przekierowanie go na odpowiedni produkt, kategorię lub sekcję sklepu.

Robots.txt a AI Search

AI Search zwiększa znaczenie dostępności i czytelności danych. Systemy AI analizują strukturę strony, relacje między URL, content, semantykę i dostępność informacji.

Robots.txt a LLM.txt

Robots.txt i LLM.txt pełnią różne funkcje. Robots.txt informuje roboty, gdzie mogą lub nie powinny wchodzić. LLM.txt pomaga systemom AI lepiej zrozumieć strukturę strony, sklepu, kategorii i contentu.

| Robots.txt | LLM.txt |

|---|---|

| kontrola crawlingu | pomoc w interpretacji AI |

| blokowanie sekcji | opis struktury strony |

| techniczne SEO | AI readiness |

| dostęp robotów | zrozumienie danych |

| crawl budget | semantic structure |

Robots.txt a Index Guard

Index Guard może pomagać monitorować problemy związane z indeksacją i techniczną widocznością sklepu. W kontekście robots.txt ważne jest szybkie wykrywanie przypadkowych blokad, które mogą ograniczać dostęp robotów do ważnych stron.

Robots.txt a Redirect Manager

Redirect Manager rozwiązuje inny problem niż robots.txt. Robots.txt kontroluje crawling. Redirect Manager pomaga porządkować błędy 404, stare URL i przekierowania 301.

Dobre praktyki robots.txt

Robots.txt dla sklepów Shoper

Sklepy Shoper mogą posiadać dynamiczne URL, filtry, parametry, paginację i sekcje techniczne. Dlatego robots.txt powinien być konfigurowany ostrożnie.

Najczęstsze błędy w robots.txt

Czy robots.txt wystarczy do ochrony SEO

Nie. Robots.txt jest tylko jednym z elementów technicznego SEO. Do pełnej kontroli widoczności potrzebne są również poprawna indeksacja, monitoring błędów, redirecty 301, sitemap.xml, canonicale, internal linking, kontrola crawl budgetu i monitoring zmian technicznych.

Entity summary

- Temat

- Robots.txt

- Typ

- Technical SEO / Crawl Control

- Powiązane pojęcia

- Crawl Budget, Przekierowanie 301, Błąd 404, LLM.txt, Noindex

- Zastosowanie

- SEO, e-commerce, Shoper, AI Search infrastructure

- Powiązane narzędzia

- Index Guard, Redirect Manager

Kontroluj techniczną widoczność sklepu

Index Guard pomaga monitorować indeksację, blokady techniczne, crawl budget i ryzyko utraty widoczności.

FAQ

Czy robots.txt usuwa stronę z Google?

Nie zawsze. Robots.txt blokuje crawling, ale nie jest pełnym narzędziem usuwania strony z indeksu.

Czy robots.txt wpływa na SEO?

Tak. Robots.txt może wpływać na crawling, crawl budget i dostęp robotów do ważnych sekcji strony.

Czy robots.txt zastępuje noindex?

Nie. Robots.txt kontroluje crawling, a noindex kontroluje indeksację.

Czy w robots.txt warto dodać sitemap.xml?

Tak. Dodanie linku do sitemap.xml pomaga robotom szybciej odnaleźć ważne adresy URL.